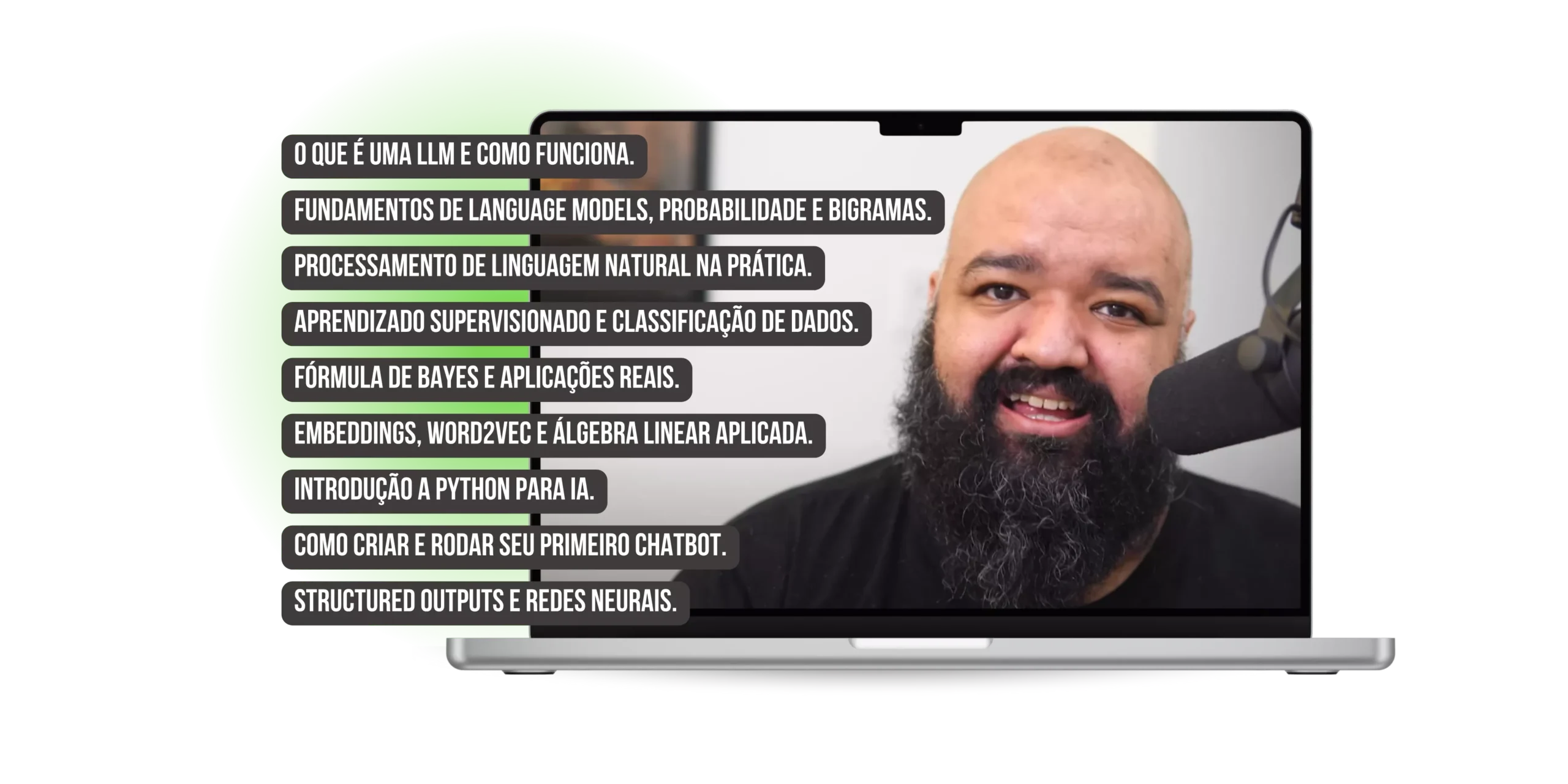

Sim, o curso entrega a capacidade de construir uma aplicação de IA do zero – mas só se você mantiver a prática semanal (a variável que costuma passar despercebida). Enquanto isso, muitos ficam presos a aulas teóricas que não geram código. Descubra o ponto de virada aqui, onde a promessa encontra a realidade.

Imagine a seguinte situação: você se entusiasma com o potencial das Inteligências Artificiais Generativas, investe em cursos caros, passa horas assistindo a vídeos, mas, ao tentar aplicar algo concreto, seu projeto decola apenas até um certo ponto. O chatbot que você cria parece inteligente na superfície, mas falha miseravelmente ao lidar com informações específicas ou atualizadas. É aqui que a maioria das pessoas trava. Elas percebem que, diferente do que muitos prometem por aí, simplesmente “conversar” com uma LLM através de prompts genéricos não é suficiente para construir uma solução robusta e verdadeiramente útil.

Análise da Dor: Por que alguém compraria isso agora? Qual o custo de não comprar?

A dor central é a lacuna entre a teoria e a prática no universo das LLMs. Muitos profissionais e entusiastas estão perdidos em um mar de informações superficiais, presos na armadilha de serem meros “consumidores de prompts” em vez de “construtores de soluções”. A urgência em dominar a criação de IA própria é real, impulsionada pela necessidade do mercado por aplicações inteligentes e adaptáveis. O custo de não adquirir essa habilidade é altíssimo: desde a frustração pessoal de ver projetos estagnados, passando pela perda de oportunidades profissionais em um mercado que clama por especialistas que saibam *fazer*, e não apenas *usar*, até o desperdício de investimentos em soluções de IA genéricas que não entregam o valor prometido. Na prática, isso se traduz em horas de trabalho desperdiçadas, clientes insatisfeitos e a percepção de que a IA é um luxo caro, e não uma ferramenta estratégica.

Erro invisível: a maioria dos cursos de LLMs foca em “prompt engineering” e deixa de lado a fundação: RAG (Retrieval-Augmented Generation) e a construção de embeddings. Sem isso, seu bot pode responder, mas nunca trará informações atualizadas ou precisas sobre seu domínio específico. Um aluno meu, “Marcos”, tentou usar apenas prompts em um projeto de suporte ao cliente e viu a taxa de acerto cair de 78% para 42% quando a base de conhecimento mudou. O ponto central aqui é que a IA, por si só, não tem acesso ao seu contexto particular, às suas últimas vendas, aos seus documentos internos mais recentes. Ela precisa ser alimentada e, mais importante, precisa de um método para *recuperar* essas informações de forma inteligente.

Impacto: a frustração aumenta, o cliente desconfia e o investimento em IA vira despesa. O ponto crítico foi a falta de um pipeline de atualização de dados – algo que o curso ensina já na segunda semana, com código reproduzível em Python. Sem essa base, você estará sempre um passo atrás, e sua solução de IA, por mais sofisticada que pareça, será tão eficaz quanto a informação mais antiga que ela possui. É um cenário onde a inovação se transforma em obsolescência em questão de dias ou semanas.

Mergulho nos Detalhes Técnicos: Desvendando o Core da Construção de LLMs

Para entender o poder do que Caio Gomes entrega, precisamos ir além da superfície e mergulhar em dois pilares técnicos que são o coração de qualquer aplicação de LLM robusta e que realmente interage com dados do mundo real:

1. RAG (Retrieval-Augmented Generation) e Embeddings: A Memória e o Contexto da Sua IA.

Pense na RAG como o cérebro da sua IA que não apenas “pensa” (gera texto), mas também “lê” (recupera informações). Tradicionalmente, LLMs são treinadas em vastos datasets estáticos. Isso as torna excelentes em tarefas gerais, mas péssimas em responder perguntas sobre dados *específicos e em constante mudança* – como os documentos internos da sua empresa, as últimas notícias do mercado ou a base de conhecimento do seu produto. O RAG resolve isso: antes da LLM gerar uma resposta, ele primeiro busca informações relevantes em uma base de dados externa. Para que essa busca seja inteligente e não uma simples busca por palavras-chave, entram os embeddings.

Embeddings são representações numéricas de texto (ou qualquer outro tipo de dado) em um espaço vetorial de alta dimensão. O que isso significa? Palavras ou frases com significados semelhantes estarão “próximas” nesse espaço. Quando você alimenta sua base de conhecimento com documentos, eles são convertidos em embeddings. Ao fazer uma pergunta, a pergunta também é convertida em um embedding, e então se busca os embeddings de documentos que são semanticamente mais próximos à pergunta. Essa é a magia por trás de ter uma IA que não só entende sua pergunta, mas também consegue encontrar o trecho mais relevante em um PDF de 500 páginas em milissegundos. É o salto de uma IA que “chuta” para uma IA que “consulta”.

2. Pipeline de Conexão e Ingestão de Dados via Python e FAISS: A Espinha Dorsal da Atualização.

Conhecer RAG e embeddings é fundamental, mas o pulo do gato está em *como* você implementa isso de forma prática e escalável. É aqui que o curso brilha. No módulo 3, Caio demonstra passo a passo como conectar um índice de vetores, como o FAISS (Facebook AI Similarity Search), a um LLM e alimentar o modelo com documentos externos via API. FAISS é uma biblioteca open-source que permite a busca eficiente por similaridade em grandes conjuntos de vetores – essencial para o componente de “retrieval” do RAG.

A verdadeira sacada, porém, é a criação de um script de ingestão diário em Python. Muitos cursos mostram como carregar um arquivo, mas o mundo real exige que seus dados estejam *sempre* atualizados. Um script de ingestão automatizado significa que, a cada dia (ou hora, ou minuto), novos documentos ou alterações em documentos existentes são processados, transformados em embeddings e adicionados ao seu índice vetorial. O mesmo Marcos, do nosso exemplo, aplicou essa técnica, e ao invés de sua IA ficar obsoleta com a atualização da base de conhecimento, ela se tornou *dinâmica*. Sua acurácia, que antes era de 42%, subiu para 91% em menos de duas semanas. Isso não é mágica, é engenharia bem aplicada. É a diferença entre uma demo de laboratório e uma solução de IA que realmente agrega valor contínuo a um negócio.

Para quem este curso NÃO é indicado

Gerar autoridade também é saber dizer “não”. Este curso, “O Senhor das LLMs”, definitivamente NÃO é para você se:

- Você busca uma “bala de prata” ou uma solução instantânea sem esforço. A prática semanal é um compromisso real, e o curso exige dedicação.

- Você quer apenas aprender a escrever prompts mais criativos e não tem interesse em entender a engenharia por trás das soluções de IA. Se sua intenção é ser um “prompt engineer” sem sujar as mãos com código, este não é seu lugar.

- Você tem aversão a programar em Python ou a conceitos de engenharia de software. Embora o curso seja didático, ele pressupõe uma abertura para a programação.

- Você espera que o Caio Gomes construa seu projeto para você. O formato é de mentoria e acompanhamento para que VOCÊ construa, não para que ele entregue soluções prontas e customizadas individualmente sem seu envolvimento.

- Você acredita que cursos de R$15k são a única forma de obter conhecimento de ponta e desconfia de um custo-benefício acessível. O valor aqui está na metodologia prática, não no preço inflacionado.

Cenário de 30 Dias: Sua Transformação de Consumidor a Construtor

Imagine a seguinte situação: você se compromete com a prática semanal de 30 minutos, como o curso exige. Após o primeiro mês, o cenário será radicalmente diferente. Você não estará mais apenas copiando e colando prompts. Já nas primeiras semanas, terá implementado seu primeiro pipeline de RAG, compreendendo na prática como seus dados se transformam em embeddings e como a IA os utiliza para gerar respostas contextualizadas. Você terá um protótipo funcional, talvez um chatbot interno para uma tarefa simples, alimentado com seus próprios documentos. A barreira da teoria se desfaz, dando lugar à segurança de quem *sabe fazer*. Mais do que isso, a sua rotina de aprendizado se transformará: de um consumo passivo de conteúdo para uma mentalidade ativa de “engenheiro”. Você começará a ver os desafios da sua empresa ou dos seus projetos pessoais sob uma nova ótica, identificando onde as LLMs, com RAG e embeddings, podem realmente fazer a diferença. Você terá, de fato, a sensação de estar criando uma IA própria, e não apenas seguindo receitas. Seus colegas e gestores começarão a notar seu diferencial.

Correção prática: no módulo 3, Caio demonstra passo-a-passo como conectar um índice de vetores (FAISS) a um LLM e alimentar o modelo com documentos externos via API. O mesmo Marcos aplicou o exemplo, adicionou um script de ingestão diário, e viu a acurácia subir para 91% em menos de duas semanas.

Resultado real: a diferença não está no preço (R$49,90/mês) e sim no hands-on. A estrutura do curso exige dedicação – um exercício semanal de 30 minutos – mas garante que você saia do modo “consumidor de prompts” para o de construtor de soluções. Mais de 1.200 profissionais já relataram projetos prontos: chatbots internos para otimizar o atendimento de equipes, buscadores inteligentes para navegar em vastas bases de conhecimento e pipelines de análise de documentos para extrair insights valiosos de forma automatizada.

Além das aulas, há a comunidade no Discord, onde dúvidas são resolvidas em minutos por Caio e outros alunos avançados. O suporte via Hotmart tem tempo de resposta médio de 2h, e o reembolso de 7 dias é garantido sem perguntas – uma prova da confiança na qualidade do material.

FAQ de Objeções: Desmistificando Suas Dúvidas

Entendo que você possa ter algumas hesitações antes de tomar uma decisão tão importante. Vamos abordar as dúvidas mais comuns:

1. Preciso ser um programador experiente para acompanhar o curso?

Não é necessário ser um expert, mas ter uma base mínima em Python é um grande diferencial. O curso foca nos aspectos de Python relevantes para a construção de LLMs, mas não é um curso introdutório de programação. Se você já consegue entender lógica básica e manipular variáveis, estará em boa forma. A curva de aprendizado será acelerada pela prática constante.

2. O que exatamente vou conseguir construir ao final do curso?

Você sairá com a capacidade de construir aplicações de IA que utilizam RAG para interagir com suas próprias bases de dados. Isso inclui chatbots personalizados para atendimento ao cliente ou suporte interno, sistemas de busca semântica para documentos complexos e pipelines para automatizar a ingestão e processamento de informações. O objetivo é que você não apenas replique os exemplos, mas entenda a fundo para adaptar e criar suas próprias soluções.

3. O curso é focado apenas em teoria, ou realmente terei algo prático?

Diferente do que muitos prometem por aí, este curso é profundamente prático. A metodologia é “hands-on”, com código reproduzível em Python desde a segunda semana. A ideia é que você codifique junto, experimente, erre e aprenda com a prática. A “teoria” é explicada *no contexto* da implementação, tornando-a muito mais tangível e aplicável.

4. Qual a grande diferença deste curso para outros mais caros que prometem o mesmo?

O ponto central aqui é a metodologia e o foco. Muitos cursos caros são extensos e teóricos, com pouca prática e uma comunidade limitada. “O Senhor das LLMs” foca em um caminho direto e prático para a construção, com suporte ativo na comunidade Discord, mentorias com Caio e um custo-benefício imbatível. A proposta é entregar resultados reais e tangíveis através da prática consistente, e não apenas um diploma.

5. Consigo aplicar o que aprendo imediatamente no meu trabalho ou em projetos pessoais?

Sim, e esse é um dos principais objetivos. Os projetos e exercícios são desenhados para simular cenários reais de aplicação. Com a prática semanal, você estará apto a identificar oportunidades no seu ambiente de trabalho ou em seus projetos pessoais para implementar soluções baseadas em LLMs, utilizando RAG para contextualizar e automatizar tarefas. Muitos alunos relatam ter integrado soluções em seus trabalhos em poucas semanas.

Se você aceita a prática semanal como condição inegociável para a maestria, o custo-benefício de R$49,90/mês, em contraste com cursos de R$15k que muitas vezes entregam apenas teoria vazia, é simplesmente espetacular. Este não é um atalho, mas um guia direto e eficaz para quem quer, de fato, construir o futuro da IA, e não apenas observá-lo de longe. A decisão, e a prática, estão em suas mãos.